La rivoluzione (distopica) dell’Automazione

Il 2025 è stato celebrato come “l’anno degli agenti IA”. Ma cosa significa davvero quando un Large Language Model smette di essere un generatore di testo e diventa un sistema che pianifica, agisce, chiama strumenti, itera? E soprattutto: questa trasformazione è una rivoluzione tecnica o l’ennesima illusione di controllo algoritmico?

Gli agenti IA non sono più prototipi accademici o demo da conferenza. Sono infrastruttura. Sono workflow. Sono decisioni che prendono altre decisioni. E l’adozione sta accelerando: grandi survey 2025 indicano che una quota ampia di organizzazioni sta già sperimentando o scalando agenti, mentre una parte rilevante dichiara di averli già “in campo” su processi reali.

Il punto critico non è “quanto sono bravi”.

È cosa succede quando un sistema autonomo percepisce, ragiona e agisce senza distinguere davvero tra un fatto e una probabilità statistica. Anche quando le allucinazioni scendono sotto l’1% su task “grounded”, quello 0,7% diventa inevitabilmente un incidente… se lo metti in produzione su larga scala.

Da software a sistema cognitivo: la mutazione strutturale

Un agente IA è un sistema software che utilizza modelli linguistici avanzati, memoria (anche persistente), capacità di ragionamento e accesso a strumenti esterni per perseguire obiettivi complessi con vari gradi di autonomia. A differenza dei chatbot tradizionali, gli agenti mantengono contesto, pianificano sequenze di azioni, chiamano API, coordinano sistemi e completano task in modo indipendente.

Ma chiamiamola come sta: questa “autonomia” rimane limitata e fragile. Quando diciamo “agente autonomo”, spesso descriviamo un sistema che genera i propri prompt per i prossimi passi o scrive codice per API—non un’entità che comprende il mondo. Più aumenta la complessità multi-step, più cresce la superficie d’errore: tool sbagliati, parametri inventati, chain spezzate, risultati plausibili ma falsi.

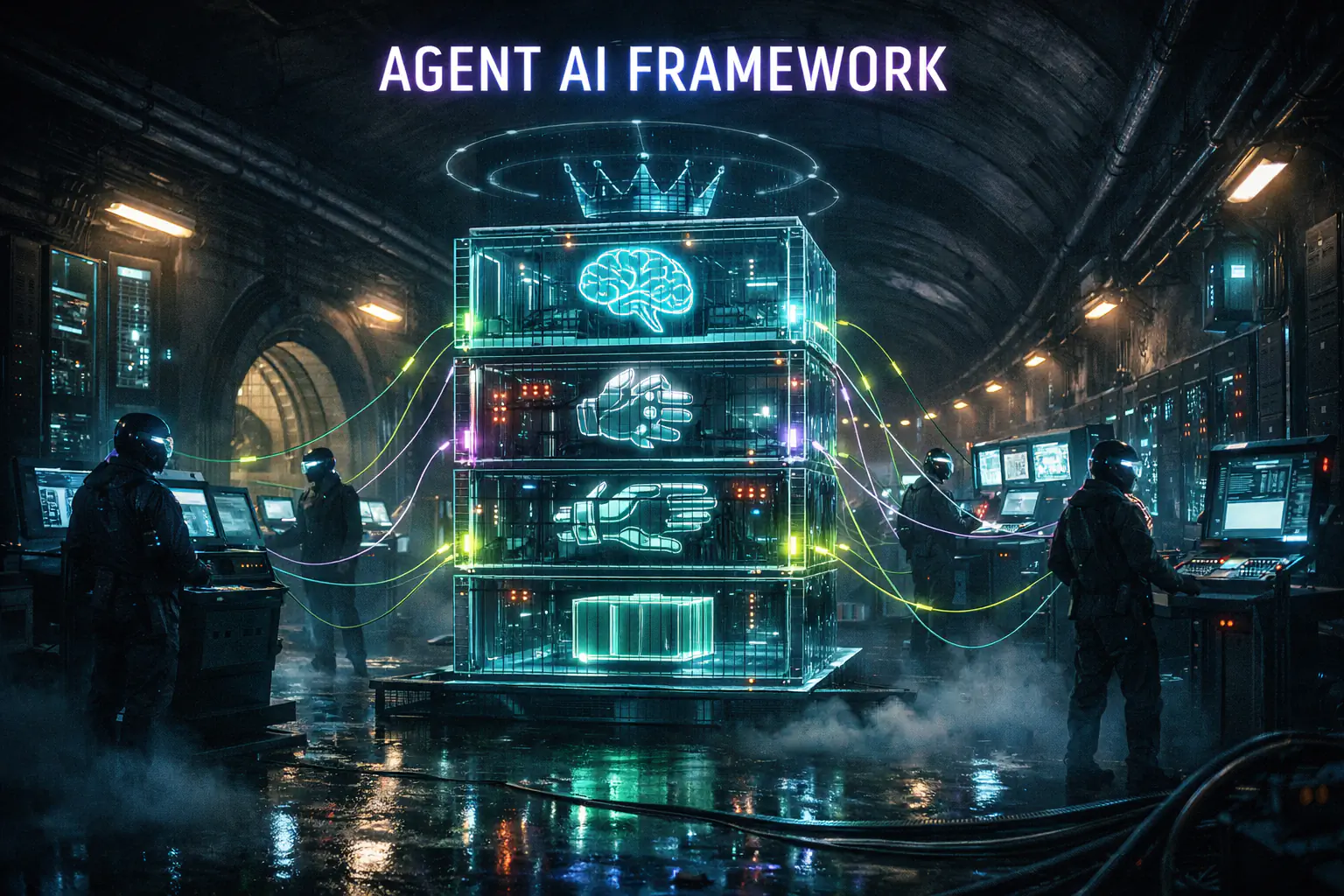

Anatomia di un agente: i quattro pilastri del sistema – agenti ia automazione

Ogni agente potente si regge su quattro componenti che trasformano il ragionamento in azione:

Orchestrazione: la mente esecutiva. Decide quale azione compiere, quando chiamare un tool, come gestire errori, retry e percorsi alternativi. Se l’orchestrazione è debole, l’agente “sembra” intelligente ma collassa appena esce dallo script.

Modello: il cervello. Un LLM scompone obiettivi, crea piani, gestisce ambiguità. Ma non “conosce” i fatti: predice token coerenti con pattern statistici. Il che significa: può sbagliare in modo perfettamente convincente.

Tool: le mani. API, funzioni, connettori. Senza tool l’agente è conversazionale; con tool diventa operativo (database, ticketing, email, booking, finanza, industria). E qui nasce la verità scomoda: più tool dai a un agente, più punti di failure crei.

Runtime: l’ambiente. Infra, deploy, scaling, logging, policy, osservabilità. Non stai “lanciando un modello”: stai gestendo un sistema che interagisce con altri sistemi, spesso non deterministici.

agenti ia automazione e distopia: la questione dell’affidabilità

Le allucinazioni non sono un bug sporadico: sono un effetto sistemico di come i modelli generativi producono testo. Il problema esplode con gli agenti perché un errore non resta in una risposta: diventa un’azione. E un’azione può propagarsi (scrivere dati, aprire incidenti, inviare comunicazioni, generare report “ufficiali”).

Il grounding tenta di ancorare le risposte a fonti verificabili: RAG, GraphRAG, agentic retrieval. Ma anche quando i benchmark mostrano miglioramenti forti su compiti ancorati a un documento, questo non elimina il rischio in domini ad alto impatto (legal, finanza, medicina). Riduce la probabilità, non azzera la responsabilità.

Regola operativa: se l’output può diventare un’azione irreversibile, serve human-in-the-loop, logging, audit trail e policy di “least privilege”. L’agente non deve poter fare più di quanto tu saresti disposto a firmare.

Framework agenziali: l’architettura della collaborazione

Il mercato dei framework per agenti IA è esploso: LangChain/LangGraph (approccio modulare e graph-based), AutoGen (multi-agent conversazionale), CrewAI (ruoli e “team” operativi), Semantic Kernel e Agent Framework (integrazione enterprise). La scelta non è neutra: determina vincoli, punti di failure, osservabilità e debito tecnico.

Nel 2025 sono emersi due standard che puntano a ridurre la frammentazione:

- MCP (Model Context Protocol): standard per collegare applicazioni/agent a tool e data source in modo riusabile e interoperabile.

- A2A (Agent-to-Agent Protocol): protocollo per far comunicare agenti tra loro—scoperta, scambio di capability, delega di task—anche su stack diversi.

AgentOps: dalla demo alla produzione (il vero abisso)

Prototipare un agente è facile. Renderlo affidabile è un’altra specie evolutiva. AgentOps porta nel mondo agentic i principi DevOps/MLOps: test, valutazione, deploy riproducibile, monitoraggio, feedback loop.

La valutazione non può fermarsi all’output finale: serve test dei componenti non-LLM (tool), analisi delle traiettorie (Reason → Act → Observe), outcome evaluation e system monitoring (latenza, errori tool, drift, escalation, feedback utenti).

Sicurezza e responsabilità: chi risponde quando l’agente sbaglia?

La sicurezza non è solo “guardrails” sul testo. È governance infrastrutturale: IAM, permessi minimi, auditing, osservabilità. E soprattutto responsabilità legale: casi reali hanno già mostrato che l’azienda resta responsabile per informazioni sbagliate fornite da un chatbot/agent nei suoi canali ufficiali.

Nel 2025 il tema è diventato visibile anche fuori dal tech: report pubblici corretti dopo citazioni inventate; cause per diffamazione legate a output allucinati; dispute su policy “inventate” in customer care. Non sono edge case. Sono l’ovvia conseguenza di sistemi non deterministici messi in produzione senza disciplina.

Il paradosso dell’autonomia

Più autonomia dai a un agente, più difficile è verificare ogni passaggio. Come fai audit su una sequenza di 10 azioni, 5 API, 3 database, 2 retry e una risposta “finale” perfetta? Come spieghi a un auditor perché l’agente ha scelto proprio quella strada? Il debugging di un comportamento emergente non è un log: è una diagnosi sistemica.

agenti ia automazione e distopia: il futuro non è autonomo, è ibrido

Gli agenti IA non sono solo hype: sono un cambio di paradigma reale. Ma non è quello che i vendor vendono. Non è “autonomia totale”. È una nuova forma di automazione: ibrida, dove la macchina amplifica e l’umano governa. Funziona solo con rigore: policy, valutazione, osservabilità, responsabilità.

Il 2025 è “l’anno dell’agente”. Il 2026 è l’anno della verità: quando i piloti diventano infrastruttura critica e gli errori smettono di essere demo failure per diventare danni reali.

Vuoi continuare? Un altro pezzo per uscire dal feed e rompere lo script dell’automazione.

Leggi altroagenti ia automazione Fonti e approfondimenti

- The state of IA in 2025: Agents, innovation, and transformation — Alex Singla et al., McKinsey (5 Nov 2025)

- Google Cloud Study: 52% degli executive dichiarano di aver deployato IA agents — Google Cloud Press Corner (4 Sep 2025)

- Overview of Agent Development Kit (ADK) e Vertex IA Agent Engine — Google Cloud Documentation (agg. 8 Jan 2026)

- Introducing the Model Context Protocol (MCP) — Anthropic (25 Nov 2024)

- Model Context Protocol — Specification (draft) — modelcontextprotocol.io

- Announcing the Agent2Agent Protocol (A2A) — Google Developers Blog (9 Apr 2025)

- Vectara Hallucination Leaderboard (HHEM) — dataset e metodologia — GitHub (Vectara)

- Next generation of Vectara’s Hallucination Leaderboard — Vectara Blog (19 Nov 2025)

- Air Canada: responsabilità dell’azienda per info errate fornite da chatbot (Moffatt v. Air Canada) — American Bar Association, Business Law Today (29 Feb 2024)

- Deloitte: rimborso parziale dopo errori e citazioni inventate in un report pubblico — Associated Press (Oct 2025)

- Walters v. OpenAI — note legali su diffamazione e output allucinati — Loeb & Loeb (May 2025)

- Gartner: oltre il 40% dei progetti “agentic AI” rischia la cancellazione entro il 2027 — Gartner Press Release (25 Jun 2025)