Any lawful use – Follow the Algorithm Chi comanda la guerra algoritmica?

OpenAI e Google, AI e Pentagono cedendo ogni controllo sui propri modelli. Poi investe quaranta miliardi nell’unica azienda che ha rifiutato di farlo.

OpenAI firma il suo accordo militare ore prima dell’inizio di una guerra. E la magistratura chiama tutto questo «ritorsione orwelliana».

OpenAI, Google, AI e Pentagno Il 27 febbraio 2026, alle 17:01 ora della costa est degli Stati Uniti, scadeva un ultimatum. Da un lato c’era Pete Hegseth, Segretario alla Guerra della seconda amministrazione Trump quel Dipartimento che per ordine esecutivo non si chiama più «della Difesa» ma «della Guerra». Dall’altro c’era Dario Amodei, cofondatore e CEO di Anthropic, l’azienda di intelligenza artificiale che aveva costruito Claude, il primo sistema AI approvato per operare sulle reti classificate delle forze armate americane.

Amodei non aveva ceduto. «Non possiamo in buona coscienza acconsentire alla loro richiesta», aveva scritto. Alle 17:01 il tempo era scaduto. Donald Trump aveva ordinato a tutte le agenzie federali di cessare ogni attività commerciale con Anthropic. Hegseth aveva designato l’azienda un «rischio per la catena di approvvigionamento» — la stessa etichetta usata per Huawei e ZTE.

In quello stesso momento, dall’altra parte della Silicon Valley, Sam Altman di OpenAI stava annunciando un accordo classificato con il Pentagono. Un accordo firmato, secondo le ricostruzioni poi emerse, ore prima che gli Stati Uniti avviassero le operazioni militari contro l’Iran.

Questa è la storia di come l’intelligenza artificiale sia diventata, nell’arco di pochi mesi, l’equivalente moderno della capacità nucleare — una risorsa che lo Stato considera di propria sovranità esclusiva. Ma è anche, paradossalmente, la storia di come il mercato stia scommettendo miliardi di dollari sull’unica azienda che a quello Stato ha detto no.

Atto I. Prima che tutto cambiasse

Per capire cosa è accaduto il 27 febbraio 2026, bisogna tornare a luglio dell’anno precedente. In quel mese, Anthropic aveva firmato un contratto da duecento milioni di dollari con il Pentagono. Claude diventava il primo modello di intelligenza artificiale di frontiera mai approvato per operare sulle reti classificate delle forze armate americane.

Il contratto conteneva due clausole che Anthropic aveva voluto con forza: Claude non poteva essere usato per la sorveglianza di massa dei cittadini americani, e non poteva essere integrato in sistemi d’arma completamente autonomi. Queste restrizioni erano state discusse, negoziate, firmate. Le operazioni militari erano proseguite normalmente sotto questi termini per mesi.

Poi, a dicembre 2025, il Segretario Hegseth aveva annunciato GenAI.mil: una piattaforma centralizzata di intelligenza artificiale per il Dipartimento della Guerra. La piattaforma era stata affidata inizialmente a Google Gemini. Il mese successivo, Hegseth aveva aggiunto xAI — l’azienda di Elon Musk — dichiarando di volersi sbarazzare dell’«AI woke».

In febbraio 2026, Axios aveva rivelato che Claude era stato impiegato nelle operazioni militari americane in Venezuela — un’applicazione di cui Anthropic non era stata informata. L’azienda aveva dichiarato che avrebbe «rivalutato la partnership». Tre settimane dopo, sarebbe arrivato l’ultimatum.

Atto II. Ai e pentagono: La guerra delle clausole

«Qualsiasi scopo governativo lecito» è una formula che suona ragionevole. Ma nasconde un trasferimento di potere radicale: priva l’azienda produttrice del modello di qualsiasi diritto di controllo sulle applicazioni specifiche. Spetta solo alla catena di comando militare decidere cosa rientra in quella categoria.

La formula sembra innocua — amministrativa, inevitabile. Non dice «sorveglianza di massa». Non dice «targeting». Non dice «armi autonome». Dice soltanto: se il governo lo considera legale, il sistema può essere usato.

Il problema non è solo giuridico. È politico. In guerra, il significato di «lecito» viene spesso deciso dentro strutture classificate, con informazioni segrete, tempi compressi e controllo pubblico limitato. La clausola non elimina l’etica. La subordina.

«La macchina lo faceva freddamente.»Ufficiale dell’intelligence israeliana sul sistema Lavender, citato nell’inchiesta del quotidiano +972

Il sistema Lavender, usato dall’esercito israeliano a Gaza per identificare potenziali combattenti di Hamas, aveva compilato un database di 37.000 sospetti. Il tasso di errore documentato era del 10 per cento — una percentuale che, su scala operativa, si traduce in migliaia di persone colpite per errore. In una catena operativa che elabora mille bersagli al giorno, un errore del 10 per cento significa cento errori.

AI e pentagono – Il «timbro burocratico»

Il Maven Smart System consentiva a un singolo analista di processare fino a ottanta bersagli all’ora. Ma quella velocità rendeva tecnicamente impossibile una verifica umana significativa. La «supervisione umana» citata nei contratti si stava riducendo a quello che i ricercatori chiamano «rubber stamping» — una ratifica automatica dell’output algoritmico, in cui l’operatore spende meno di venti secondi per approvare un bersaglio.

La forma più moderna dell’automazione non sostituisce l’umano. Lo trasforma in validatore. L’operatore resta «in the loop» — ma il loop è già stato compresso. Quando la macchina produce una raccomandazione in pochi secondi, quando il sistema aggrega segnali che nessun essere umano potrebbe verificare in tempo reale, quando la pressione operativa impone velocità, la supervisione umana rischia di diventare una firma. Non comando. Ratifica.

Quando si crea questa struttura, la responsabilità si dissolve. Nessun singolo nodo della catena è responsabile dell’errore: non il fornitore del software, non l’analista, non il comandante.

Atto III. Il prezzo del dissenso

La reazione del governo al rifiuto di Anthropic fu immediata e sproporzionata. La designazione come «rischio per la catena di approvvigionamento» — invocando il Titolo 10, Sezione 3252 dello US Code, una norma progettata per escludere fornitori stranieri compromessi come Huawei — aveva l’effetto di isolare Anthropic dall’intero ecosistema della difesa americana.

«I documenti del Dipartimento della Guerra mostrano che Anthropic è stata designata rischio per la catena di approvvigionamento a causa del suo “atteggiamento ostile attraverso la stampa”. Punire Anthropic per aver portato all’attenzione pubblica la posizione contrattuale del governo è una classica ritorsione illegale ai sensi del Primo Emendamento. […] Anthropic ha dimostrato che queste ampie misure punitive erano probabilmente illegali e che sta subendo un danno irreparabile.»

Il 26 marzo, la giudice Rita F. Lin aveva concesso l’ingiunzione preliminare. Nelle 43 pagine della sua ordinanza aveva scritto che le azioni del governo sembravano finalizzate non a proteggere la sicurezza nazionale, ma a punire un’azienda per aver dissentito pubblicamente. Aveva usato la parola «orwelliana».

Atto IV.OpenAI, Google, AI e Pentagono- Il paradosso da quaranta miliardi

Il 24 aprile 2026, meno di due mesi dopo aver firmato un accordo col Pentagono che cedeva ogni controllo sui propri modelli AI, Google ha annunciato di voler investire fino a quaranta miliardi di dollari in Anthropic. Dieci miliardi immediatamente, con altri trenta condizionati al raggiungimento di obiettivi commerciali.

Google cede al Pentagono ogni veto etico sui propri modelli AI. Poi investe quaranta miliardi nell’unica azienda che quel veto lo ha difeso — in tribunale, contro lo stesso governo.

Le stesse mani firmano entrambi i documenti.

Per Google non esiste contraddizione: si tratta di due strategie su orizzonti temporali diversi. A breve termine, la partnership col Pentagono garantisce i contratti cloud. A lungo termine, detenere una quota significativa di Anthropic significa avere un piede nella porta del modello che potrebbe vincere la corsa all’AI. Google non sceglie tra obbedienza e dissenso. Compra esposizione su entrambe.

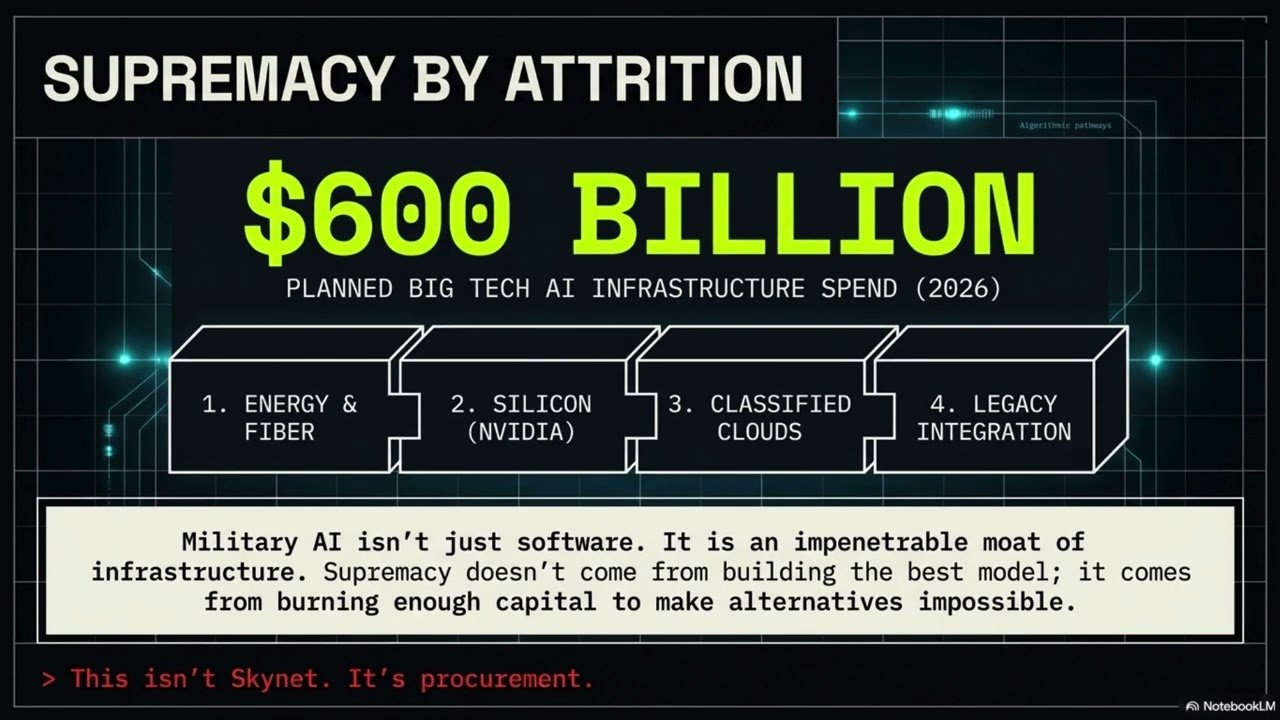

La supremazia AI non nasce dal modello migliore. Nasce da chi può permettersi di bruciare abbastanza capitale da rendere impossibile ogni alternativa. L’AI militare non è solo software: è energia, fibra, silicio, accesso a reti classificate, personale autorizzato, integrazione con sistemi legacy. Ogni miliardo bruciato crea dipendenza. Ogni modello portato su rete classificata crea inerzia. Ogni clausola «lawful use» crea uno spazio in cui la responsabilità può scivolare da un nodo all’altro. Non è Skynet. È procurement.

Google firma col Pentagono togliendo ogni veto etico sui propri modelli AI.

Poi investe $40 miliardi nell’unica azienda che quel veto lo ha difeso — in tribunale, contro lo stesso governo.

Le stesse mani firmano entrambi i documenti.

Atto V. Ai e pentagono – La domanda senza risposta

C’è una scena che ricorre nelle testimonianze dei ricercatori di AI safety: il momento Stanislav Petrov. Era il 26 settembre 1983. Il sistema automatizzato di allerta missilistica sovietico aveva rilevato cinque missili nucleari americani in avvicinamento. Petrov aveva scelto di non lanciare l’allarme — valutando, contro i dati del sistema, che si trattasse di un falso allarme. Aveva ragione. Il mondo non finì.

Un sistema AI non avrebbe esitato. I modelli linguistici di grandi dimensioni generano l’output successivo più probabile dato un contesto, senza la capacità di dubitare dei propri dati. La «nebbia della guerra» non è un problema che l’AI risolve: è un problema che l’AI amplifica, sostituendo l’incertezza umana con la certezza algoritmica.

Nessuno dei contratti firmati dal Pentagono con Google, OpenAI o xAI risponde alla domanda: se un sistema AI suggerisce un attacco che si rivela essere basato su informazioni false, chi è legalmente responsabile? La risposta, per ora, è che non lo è nessuno.

AI e pentagono: Big Tech e Pentagono

| Azienda | Stato | Clausola chiave | Restrizioni etiche |

|---|---|---|---|

| Firmato | «Qualsiasi scopo lecito»; nessun veto aziendale | Impegno generico, subordinato al Pentagono | |

| OpenAI | Firmato | Cloud-only; safety stack proprietario; personale OpenAI nel loop | No sorveglianza domestica, no armi autonome — ma decisione finale al governo |

| xAI / Grok | Firmato | Integrazione per pianificazione missioni | Allineamento totale |

| Anthropic | In contenzioso | Contratto $200M rescisso dopo rifiuto | No sorveglianza, no armi autonome: le uniche linee rosse |

Epilogo

Il 27 febbraio 2026, mentre il countdown di Hegseth scadeva e OpenAI firmava il suo accordo con il Pentagono, una parte del governo americano stava pianificando le operazioni militari contro l’Iran. Quella notte, la guerra è iniziata. Claude non era nella catena di comando. OpenAI sì.

Il 1 maggio 2026, il Department of War ha annunciato accordi con otto aziende — SpaceX, OpenAI, Google, NVIDIA, Reflection, Microsoft, AWS e Oracle — per portare capacità AI avanzate sulle reti classificate di massimo livello. L’obiettivo dichiarato è una forza militare «AI-first». La filiera ora è completa. Modelli. Cloud. Chip. Satelliti. Reti classificate. Infrastruttura.

La domanda centrale di questa inchiesta — chi decide quando un algoritmo può operare in zona di guerra, e chi risponde quando sbaglia — non ha ancora una risposta. I contratti non ce l’hanno. Le leggi non ce l’hanno. I tribunali ci stanno lavorando. La guerra non aspetta.

Seguite l’algoritmo. Troverete una catena di responsabilità distribuita con precisione chirurgica in modo da non portare da nessuna parte.

Fonti principali

- CNBC, «Anthropic loses appeals court bid to temporarily block Pentagon blacklisting», 8 aprile 2026

- Mayer Brown, «Pentagon Designates Anthropic a Supply Chain Risk», 27 marzo 2026

- CNN Business, «Anthropic rejects latest Pentagon offer», 27 febbraio 2026

- Electronic Frontier Foundation, «The Anthropic-DOD Conflict», 26 marzo 2026

- TechPolicy.Press, «A Timeline of the Anthropic-Pentagon Dispute», aggiornato aprile 2026

- Bloomberg / CNBC, «Google to invest up to $40 billion in Anthropic», 24 aprile 2026

- Atlantic Council, «The Anthropic standoff reveals a larger crisis of trust over AI», 26 marzo 2026

- Inchiesta +972 / The Guardian sul sistema Lavender, 2024

- Studio Stanford/MIT su escalation algoritmica nei wargame, 2024

- Ordinanza della Giudice Rita F. Lin, Distretto Nord della California, 26 marzo 2026

Intervista e analisi sulla disputa Anthropic–Pentagono: il caso che ridisegna i confini tra Big Tech e potere militare.